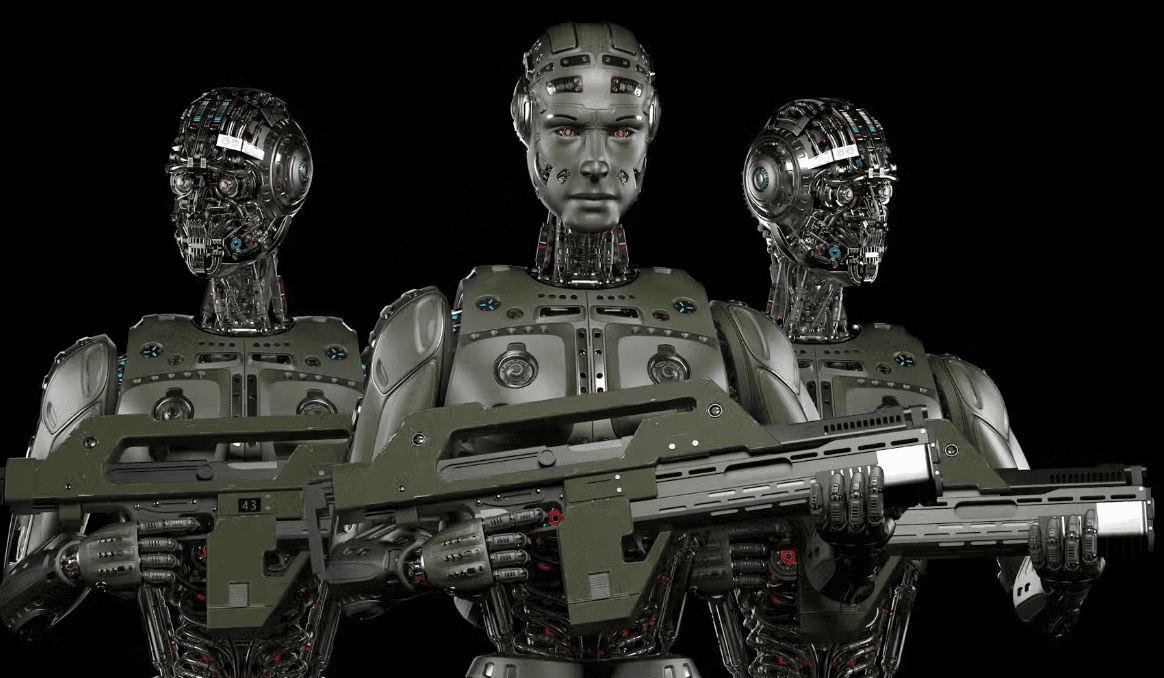

Сегодня следы искусственного интеллекта есть во всех областях, которых касалось человечество. Искусство, литература, космос, здоровье, еда, сельское хозяйство… Искусственный интеллект, развивающийся с каждым днем, как и его преимущества, также несет на себе отпечаток человечества с точки зрения возможного ущерба. Уже много лет ведутся исследования возможных систем нападения и защиты на полях сражений с помощью искусственного интеллекта. Хотя искусственный интеллект доступен даже в смартфонах, которые мы сегодня используем в своих руках, думать, что страны не получат выгоду от искусственного интеллекта в оборонной промышленности, — это крайне оптимистичный подход.

ПОД СЛЕДСТВИЕМ С 2022 ГОДА

США — одна из ведущих стран, проводящих крупные и важные исследования по использованию искусственного интеллекта на полях сражений. Помимо использования искусственного интеллекта не только в наступательных, но и в оборонительных целях, Пентагон пытается устранить уязвимые места в системах искусственного интеллекта, хотя потенциальные злоумышленники также могут воспользоваться преимуществами искусственного интеллекта и использовать визуальные уловки или манипулируемые сигналы. Исследовательская программа Guaranteeing AI Robustness Against Deception (GARD) занимается изучением возможных враждебных атак с 2022 года.

МОГУТ ВОСПРИНИМАТЬ АВТОБУС КАК ТАНК

Исследования показали, как безобидные на первый взгляд узоры могут обмануть ИИ и заставить его неправильно идентифицировать объекты, что может привести к катастрофическим последствиям на поле боя. Например, ИИ может принять автобус с пассажирами за танк, если на него нанести правильный визуальный шум. Это может привести к гибели невинных гражданских лиц на потенциальных полях сражений. Поскольку это может привести к возмущению общественности, Пентагон очень серьезно относится к разработке автономного оружия. Чтобы решить проблему в случае возникновения потенциальных проблем, подобных приведенной в примере, Министерство обороны недавно обновило правила разработки искусственного интеллекта и сделало их применимыми ко всем системам.

БОЛЬШАЯ ОПАСНОСТЬ НЕСПРОВОЦИРОВАННОГО НАПАДЕНИЯ

Хотя Пентагон принимает меры предосторожности против возможного негативного использования искусственного интеллекта, противники войны продолжают беспокоиться. Они утверждают, что такое оружие может привести к непреднамеренной напряженности, особенно в неспокойных районах, поскольку поддерживаемое ИИ оружие может неверно интерпретировать ситуацию и атаковать без причины, даже если кто-то не будет намеренно манипулировать сигналами. По данным Агентства перспективных оборонных исследовательских проектов, исследователи GARD из компаний Two Six Technologies, IBM, MITRE, Чикагского университета и Google Research создали ряд виртуальных испытательных стендов, инструментальных пакетов, эталонных наборов данных и учебных материалов, которые теперь стали более доступными. Вот некоторые из них…

Виртуальная платформа Armory: Она служит испытательным стендом для исследователей, которым нужны повторяемые, масштабируемые и надежные оценки вражеской обороны.

Инструментарий Adversarial Robustness Toolbox (ART): Предоставляет разработчикам и исследователям инструменты для защиты и оценки моделей и приложений машинного обучения от целого ряда агрессивных угроз.

Набор данных CONText APRICOT: Позволяет проводить повторяемые исследования реальной эффективности патч-атак физических противников на системы обнаружения объектов.

Хранилище самообучения Google Research: Содержит «тестовые манекены», представляющие общую идею или подход к построению защиты.